O sztucznej inteligencji powiedziano, czasami nawet wygenerowano, wiele. Spora część nauczycieli zdążyła już wypracować własne podejście – od pełnej akceptacji i korzystania z możliwości GenAI, przez ostrożne eksperymentowanie, aż po całkowite odrzucenie. Niezależnie jednak od tego, jakie stanowisko zajmujemy, kluczowe pozostaje pytanie: czy nasza wiedza i zrozumienie tematu są wystarczające, abyśmy mogli nie tylko świadomie poruszać się w tej przestrzeni, lecz także skutecznie wspierać w tym naszych uczniów.

Konferencja LABCI Paraguay 2025

Na początku lipca wzięłam udział w konferencji LABCI PARAGUAY 2025 o wdzięcznym tytule: Human-Centric Approaches in the AI Era. Moje dotychczasowe przemyślenia na ten temat traktowałam raczej z dystansem, wiedziałam, że jest to a kind of feelings-based thing. A skoro już o emocjach mowa, od początku nie mogłam oprzeć się myśli, że tak naprawdę odpowiedź na pytanie jak AI i morze możliwości, a może nawet zastępowalności, mają się do humanizmu i naszej branży, poniekąd kryje się w samym powodzie, dla którego zdecydowałam się wziąć udział w tej konferencji. W końcu większość materiałów mogę znaleźć w sieci, bezpłatnie, a na pozostałe pytania odpowie mi AI. A jednak się zapisałam.

Choć to poczucie poniekąd znalazło potwierdzenie w tym, co usłyszałam podczas różnych sesji, konferencja, i refleksje, które pojawiły się po niej, okazały się świetną okazją, by pewne kwestie uporządkować i bardziej świadomie spojrzeć na nie w kontekście pracy z uczniami. W tym wpisie chciałabym podzielić się kilkoma wnioskami, a być może także zachęcić do własnej refleksji i poszukiwań.

Nihil novi – stary wspaniały świat

Nowe zjawiska rzadko przyjmujemy z otwartymi ramionami. Mówiąc dosadniej, to, czego nie rozumiemy, nigdy nam się nie podoba. Ale czy rzeczywiście mówienie o AI w kategoriach zupełnie nowej technologii, która z impetem wtargnęła w nasze życie, zdjęcia humanoidalnych robotów, pytania o naszą przyszłość, w domyśle zagrożoną, przybliżają nas do zrozumienia, czym jest sztuczna inteligencja?

Historia uczy nas, że niemal każda innowacja budziła lęk i podejrzenia. Kalkulator miał ogłupić uczniów, a Wikipedia, według sceptyków, sprawić, że przestaną samodzielnie szukać wiedzy i zaczną bezkrytycznie kopiować informacje z Internetu. Samego terminu Artificial Intelligence użyto po raz pierwszy w 1956 r. na konferencji w Dartmouth w USA i odnosił się do próby stworzenia programów, które mogłyby rozwiązywać problemy podobnie jak człowiek. Przykładem rozwiązań tego typu z których od lat korzystamy są chociażby: nawigacja, rekomendacje Netflixa, czy Google Translator. Debiut ChatGPT w 2022 sprawił, że generatywna sztuczna inteligencja zyskała szersze zainteresowanie.

Badania nad sztuczną inteligencją od początku były powiązane z próbą zrozumienia ludzkiej inteligencji. Przez lata szachy uchodziły za jej test najwyższego stopnia. Gdy w 1997 r. komputer Deep Blue pokonał Garri Kasparowa, wielu komentatorów uznało to za przełom. Szybko jednak okazało się, że szachy, mimo swej złożoności, są dla komputera stosunkowo łatwe, bo mają jasno określone reguły i skończoną liczbę możliwych ruchów. Zjawisko to wpisuje się w tzw. efekt AI – to, co dawniej uchodziło za przykład sztucznej inteligencji, z czasem sprowadza się do zwykłego obliczenia, które już nie zasługuje na to miano i jets po prostu zwykłym oprogramowaniem.

Antropomorfizacja

Warto podkreślić, że próba zdefiniowania sztucznej inteligencji nie jest wcale łatwa, ponieważ nie ma jednej, powszechnie obowiązującej definicji. To, czym ona jest, zależy w dużej mierze od kontekstu – inaczej opisze ją informatyk, inaczej prawnik. Nie ułatwiają nam też zrozumienia tego zjawiska hasła marketingowe, w których prym wiodą frazy takie jak: „tworzy nową, unikatową zawartość”, „niezwykła zdolność do tworzenia” czy nawet, jak pisze o niej Microsoft: „podobnie jak szef kuchni, który gotuje unikatowe dania, muzyk, który komponuje utwory, lub autor, który pisze historie, generatywna AI jest kreatywna i innowacyjna”.

Można powątpiewać, czy tego typu definicje przybliżają nas do zrozumienia mechanizmów działania tego zjawiska. Z pewnością marketingowe określenia padają na podatny grunt, ponieważ nasza tendencja do postrzegania świata przez pryzmat własnej natury i doświadczeń sprawiają, że chętnie odwołujemy się do takich właśnie określeń. Antropomorfizm bywa naszym sposobem na zrozumienie świata, a naszą naturalną potrzebę nawiązywania więzi z innymi ludźmi czasem przenosimy także na rzeczy, co w tym przypadku bywa zgubne. To nie algorytm, ani model językowy przyciągają naszą uwagę, lecz wyobrażenie: oto pojawił się towarzysz myśli, asystent. Jednak rzeczywistość jest mniej efektowna, za rozmową kryją się algorytmy, które nie myślą, nie czują i nie uczą się jak człowiek. Pierwszy obraz łatwiej trafia do odbiorców, bo wywołuje silniejsze emocje niż zwykły, pozbawiony dramatyzmu model językowy, dlatego warto oprzeć się pokusie antropomorfizacji sztucznej inteligencji i próbować ją lepiej zrozumieć.

Czym więc jest sztuczna inteligencja? Zgodnie z definicją Komisji Europejskiej (2018, s. 1), AI to ,,systemy, które wykazują inteligentne zachowanie dzięki analizie otoczenia i podejmowaniu działań – do pewnego stopnia autonomicznie – w celu osiągnięcia konkretnych celów”. To systemy, które mają rozwiązywać problemów w sposób podobny do człowieka. W definicjach anglojęzycznych często pojawiają się sformułowania takie jak imitate, mimic czy simulate, podkreślające zdolność do naśladowania. AI nie jest sztucznym człowiekiem, nie posiada świadomości, emocji ani moralności. To maszyna przewidująca, system analizujący dane i generujący odpowiedzi. Innymi słowy, AI wykonuje działania podobne do ludzkich, ale zupełnie innymi metodami. Słowa takie jak „myśleć”, „uczyć się” czy „inteligencja” oznaczają w tym kontekście coś zupełnie innego, choć my rozpatrujemy je pod kątem znaczenia nam znanego. To trochę jak z psem zabawką, który chodzi, szczeka i macha ogonem. Zachowuje się jak pies, lecz działa w zupełnie inny sposób. Podobnie jest ze sztuczną inteligencją: jej ,,inteligencja” to w istocie zaawansowane przetwarzanie i przewidywanie oparte na danych.

Amerykański badacz Pedro Domingos podkreślił:

People worry that computers will get too smart and take over the world, but the real problem is that they’re too stupid and they’ve already taken over the world. (Domingos, 2017, s. 286)

Dychotomia myślenia

W obszarze nowych technologii w edukacji można zauważyć skrajne podejścia. Z jednej strony znajdują się nauczyciele, którzy bezrefleksyjnie wprowadzają do pracy wszystkie dostępne rozwiązania, udostępniają dane, wrzucają materiały do sieci i maksymalnie digitalizują swoje lekcje. Z drugiej – ci, którzy w całości odrzucają innowacje, polegając wyłącznie na intuicji i doświadczeniu. Choć postawy te wydają się przeciwstawne, łączy je podobny mechanizm: niechęć do wnikliwego poznania drugiej strony, powstaje świat prostych odniesień. Jedni nie chcą słyszeć o ryzyku, drudzy – o możliwościach. Takie podejścia, choć są raczej wyjątkiem niż regułą, utrudniają świadome korzystanie z technologii i sprowadzają złożone zagadnienia do prostych etykiet: dobre/złe.

Jeśli czegoś powinniśmy się wystrzegać, to przede wszystkim pokusy łatwego, bezapelacyjnego wyrokowania. Trzeba pytać. A jakie są te najbardziej palące pytania? Oddajmy głos nauczycielom i prelegentom konferencji LABCI, którzy szukali na nie odpowiedzi.

Mam obawy o to co dzieje się z danymi, które podaje korzystając z generatywnego AI. Czy słusznie?

To realny problem, korzystając z AI nie należy wpisywać danych poufnych, takich jak imię, nazwisko, adres email, czy numer telefonu. Rozmowy z ChatGPT nie mają statusu poufnych takich jak te z lekarzem czy prawnikiem. I choć OpenAI daje możliwość usunięcia swoich danych, a także wyłączenia historii czatów to, firma musi przestrzegać nakazów sądowych i czasami, jak w 2025 roku, istnieje wymóg zachowywania danych niezależnie od usunięcia przez użytkownika, co budzi obawy o prywatność. Jest to wciąż mocno nieuregulowana kwestia stąd zalecana jest ostrożność.

Podczas wystąpienia AI in ELT: Critical Perspectives and Ethical Pathways Dr. Nicky Hockly przytoczyła przykład raportu 'How Dare They Peep into My Private Life? Children’s Rights Violations by Governments That Endorsed Online Learning During the Covid-19 Pandemic’ (2022), który szczegółowo opisuje, jak podczas pandemii COVID-19 technologie edukacyjne wykorzystane w szkołach naruszały prywatność uczniów i ich prawo do ochrony danych. Analiza obejmowała 164 produkty edukacyjne rekomendowane przez 49 państw. Aż 89% tych produktów miało możliwość nadzorowania dzieci, często po kryjomu i bez wiedzy rodziców czy samych uczniów. Gromadzono informacje takie jak: tożsamość uczniów, lokalizacja, aktywność w klasie, dane o rodzinie i znajomych, a także – jaki sprzęt mają do dyspozycji uczniowie. Większość produktów udostępniała lub miała możliwości udostępniania danych dzieci firmom reklamowym, co umożliwiało m.in. targetowanie behawioralne.

Dane wprowadzane w ChatGPT mogą być używane do trenowania modeli. Coraz więcej wydawnictw decyduje się na informacje o zakazie kopiowania treści podręczników do GenAI. Warto uświadamiać uczniów w tym zakresie.

Czy Twoi uczniowie wiedzą:

- że rozmowy z AI nie są poufne?

- jakich danych nie należy podawać podczas korzystania z narzędzi AI?

- że dane wpisane w ChatGPT mogą być wykorzystywane do trenowania modeli?

- że nawet jeśli można usunąć historię czatów, firma może mieć obowiązek ich przechowywania (np. z powodów prawnych)?

- jakie ryzyko wiąże się z kopiowaniem treści podręczników czy materiałów chronionych prawem autorskim do AI?

- że warto zawsze zastanowić się, czy pytanie i dane, które wpisuję, są neutralne, czy jednak mogą ujawniać coś wrażliwego?

Czy AI to rzeczywiście świetne źródło pozyskiwania wiedzy i warto żeby uczniowie z niego korzystali?

AI może nas wyręczyć w wielu zadaniach – potrafi przytaczać informacje, wspierać proces uczenia się czy usprawniać pracę. Nie jest jednak idealnym źródłem wiedzy. Ben Knight z Oxford University Press w swoim wystąpieniu How can we develop our students’ critical thinking skills while using AI? przytoczył następujące dane dotyczące tekstów tworzonych przez GenAI:

- 80% to treści zapamiętane, często wykrywane przez narzędzia do sprawdzania plagiatu

- 46% zawierało błędy rzeczowe

- 31% zawierało błędy logiczne

- 52% miało uchybienia w spójności/dyskursie

Z tego względu korzystający z AI powinni nie tylko umieć krytycznie analizować uzyskane wyniki, ale także selekcjonować wartościowe treści. Wymaga to zarówno wiedzy merytorycznej, którą zdobywa się korzystając z rzetelnych źródeł, jak i rozwiniętych umiejętności, takich jak krytyczne myślenie. To szczególnie ważne w edukacji. Eksperci są w stanie łatwiej dostrzec i zweryfikować błędy, natomiast dla dzieci i młodzieży może to być znacznie trudniejsze. Dlatego tak istotne staje się uczenie i ćwiczenie krytycznego myślenia, które pozwala korzystać z nowych technologii w sposób bardziej świadomy i bezpieczny.

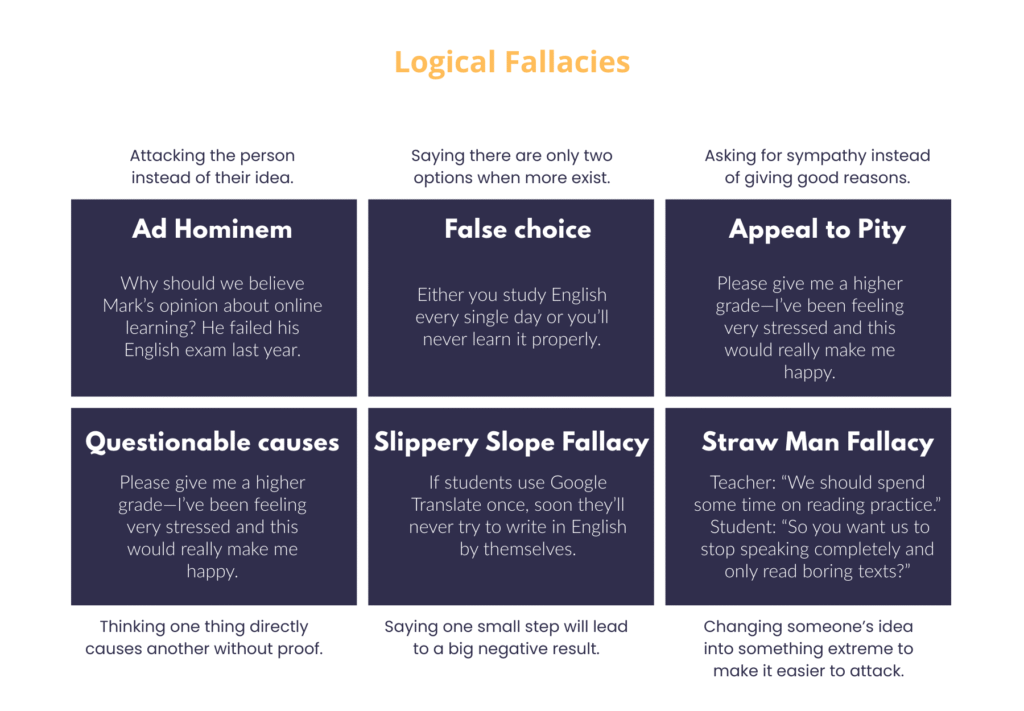

Ben Knight zaproponował nauczycielom następujące aktywności wspierające rozwój krytycznego myślenia:

Logical fallacies – przedstaw uczniom kilka najczęściej spotykanych błędów logicznych wraz z prostymi przykładami. Następnie zaproponuj ćwiczenie polegające na dopasowaniu nazw błędów do podanych przykładów. Kolejnym krokiem może być zachęcenie uczniów, aby poszukali podobnych przypadków w swoim codziennym życiu, np. w rozmowach, mediach społecznościowych czy reklamach.

Analiza problemu – rozpocznij od przedstawienia uczniom konkretnego zagadnienia do dyskusji, np. Should meat be banned in school one day a week? Następnie poproś ich, aby zastanowili się, jakie różne grupy osób mogłyby mieć odmienne spojrzenie na ten temat (np. wegetarianin, osoba jedząca mięso, rolnik, nauczyciel) i stworzenie krótkich wypowiedzi w języku angielskim I am…, I think…, I wonder…. Uczniowie wymieniają się swoimi pomysłami w parach lub małych grupach, porównują je, a następnie oceniają siłę argumentów w skali od 1 do 5. Ćwiczenie kończy się wspólnym podsumowaniem i wyciągnięciem wniosków.

Czy Twoi uczniowie wiedzą:

- że aż 80% treści tworzonych przez GenAI to po prostu zapamiętane informacje?

- że w tekstach generowanych przez AI mogą pojawiać się błędy rzeczowe i logiczne?

- dlaczego AI nie jest idealnym źródłem wiedzy i wymaga weryfikacji?

- jakie znaczenie ma krytyczne myślenie podczas pracy z AI?

- w jaki sposób można odróżnić treści wartościowe od błędnych lub powierzchownych?

Czy uczniowie korzystając z AI przestają myśleć samodzielnie?

Prawdopodobnie najbardziej palące kwestia, to pytanie zostało wielokrotnie zadane. Ryzyko rozleniwienia umysłowego jest faktem lecz problem ten po części towarzyszy nam od dawna. Podobne obawy wzbudzało chociażby pojawienie sie Wikipedii. Każde zadanie domowe czy projekt od lat wiążą się z pokusą korzystania z cudzych rozwiązań. Dlatego ważne jest, by mówić o swoistej „higienie” korzystania z narzędzi sztucznej inteligencji. AI nie powinno zastępować myślenia, lecz je wspierać. Wysiłek poznawczy, czyli moment, kiedy musimy coś przeanalizować, znaleźć rozwiązanie, albo przywołać informacje, jest kluczowy dla rozwoju mózgu. Im zadanie mniej automatyczne, tym większy wysiłek i tym samym lepszy trening umysłu. Przepisanie gotowej odpowiedzi z AI nie jest tym samym co wygenerowania kilku przykładów, ich porównanie, ocena poprawności i stworzenie własnej treści.

Warto również pokazywać uczniom na realnych przykładach, jak mądrze korzystać z takich narzędzi, w jakich sytuacjach pomoc AI może być dobrym pomysłem (na przykład, gdy uczeń nie do końca rozumie materiał szkolny może poprosić o wyjaśnienie niezrozumiałego zagadnienia na swoim poziomie oraz pokazanie dodatkowych przykładów).

Oprócz teorii ważna jest również praktyka, projektowanie zadań, które wymagają od uczniów aktywności i samodzielności. Niech komentują, porównują, szukają źródeł, sprawdzają poprawność, analizują, oceniają, tworzą. AI może być narzędziem, ale nie powinno być jedynym źródłem odpowiedzi. Przykładowe zadanie, które pojawiło się w trakcie konferencji:

Praca w grupach – nauczyciel proponuje uczniom problem do rozwiązania. Każda grupa korzysta w domu z innego narzędzia AI, aby poszukać możliwych odpowiedzi i rozwiązań. Na kolejnej lekcji uczniowie prezentują wyniki swoich poszukiwań, porównują, czym różniły się odpowiedzi poszczególnych modeli, a następnie wspólnie oceniają, które rozwiązania są najbardziej trafne i godne wdrożenia.

W tym miejscu warto zaznaczyć, że korzystanie z AI czy technologi jako takiej, nie jest konieczne, do przeprowadzenia wartościowych zajęć, a powyższe pomysły stanowiły jedynie propozycje.

Pytania do samodzielnej refleksji dla uczniów:

- Czy po otrzymaniu odpowiedzi od AI kopiuję ją bez zmian, czy raczej czytam, analizuję i sprawdzam?

- Czy dodaję coś od siebie, przeredagowuję, ulepszam lub usuwam niepotrzebne fragmenty?

- Czy sprawdzam, skąd pochodzą informacje, i weryfikuję ich prawdziwość w innych źródłach?

- Czy staram się porównać różne odpowiedzi AI, aby wybrać tę najbardziej trafną?

- Czy korzystam z AI jako pomocy do nauki, czy traktuję je jako jedyne źródło gotowych rozwiązań?

- Czy potrafię ocenić, które informacje są wartościowe, a które mogą zawierać błędy lub uproszczenia?

- Czy wykonując zadania, wykorzystuję AI do wspierania własnego myślenia, a nie do zastępowania wysiłku umysłowego?

Moje nauczanie opieram na tym, co najcenniejsze: własnych obserwacjach, intuicji i relacji z uczniem.

Nie jest to co prawda pytanie, ale refleksja dotycząca tego podejscia która towarzyszyła mi po jednej z sesji zatytułowanej Evidence-based teaching: combining science and humanism? na której padło stwierdzenie our intuitions and beliefs about how we learn are often wrong in serious ways.

Na stronie jednej ze szkół językowych przeczytałam niedawno stwierdzenie: A to właśnie motywacja do nauki jest jednym z głównych czynników przyczyniających się do odczuwania postępów. Brzmi ładnie i przekonująco, ale, o czym wspomniała Carol Lethaby, badania pokazują, że jest dokładnie na odwrót.

Choć sama prelekcja nie dotyczyła sztucznej inteligencji, świetnie wpisuje się w pytanie z tytułu konferencji: jak pozostać „human” w erze AI. Humanistyczne podejście w edukacji nie powinno oznaczać rezygnacji z badań i wiedzy naukowej na rzecz intuicji czy osobistych odczuć. Wręcz przeciwnie, prawdziwie learner-centered teaching zakłada otwartość na to, co zostało zbadane i potwierdzone, oraz gotowość do weryfikowania własnych praktyk i zrozumienia, dlaczego po nie sięgamy. Poniżej kilka przykładów jak nauka, przede wszystkim neurobiologia, psychologia poznawcza, badania edukacyjne, możą pomóc nam stać się bardziej świadomymi nauczycielami.

True or false

Differences in hemispheric dominance (left- vs. right-brain) can help explain individual differences among learners.

[konferencyjny urywek] Carol Lethaby, Evidence-based teaching: combining science and humanism?

Fałsz. Obie półkule mózgu są wykorzystywane do przetwarzania zarówno zadań logicznych, jak i kreatywnych. Nie ma dowodów na to, że niektórzy ludzie mają bardziej połączoną lub dominującą sieć lewej lub prawej półkuli mózgu.

Dlaczego decydujemy się na pre-tasks?

Celem tych zadań jest aktywacja dwóch rodzajów wiedzy: dotyczącej treści (content knowledge) oraz języka (language knowledge). Badania wskazują, że:

Asking L1 readers what they know about the topic before reading will improve performance (Campbell and Campbell, 2008).

L2 readers-learners with pre-reading background information outperformed learners without pre-reading. (Chen and Graves, 1995).

Pellicer and Sanchez (2020) found that pre-teaching vocabulary before introducing a reading text helped with both reading and vocabulary learning.

[konferencyjny urywek] Carol Lethaby, Evidence-based teaching: combining science and humanism?

Co pomoże uczniom, bez względu na wiek, zapamiętać nowe słowo?

Learning FL vocabulary with gestures is more effective than just learning through audio/visual modes. (Mathias et al, 2020)

Meaningful gestures lead to deeper encoding (stronger, better neural connections) of the new word. (Oakley et al 2021:142)

[konferencyjny urywek] Carol Lethaby, Evidence-based teaching: combining science and humanism?

Gesty nie muszą być zarezerwowane dla dzieci, nie oznaczają infantylizacji procesu nauczania i pomagają w zapamiętywaniu nowych słow. Uczniowie są różni, ale jesli widzisz potencjał na ich wprowadzenie, masz za sobą solidne dowody.

Co pomoże uczniom zapamiętać więcej nowych słów?

The limitations of working memory can be overcome by schema construction and automation.

[konferencyjny urywek] Carol Lethaby, Evidence-based teaching: combining science and humanism?

Warto pomagać uczniom tworzyć schematy, np. wprowadzać słownictwo w kontekście, grupować tematycznie, pokazywać powiązania między słowami i strukturami.

Retrieving or repeating?

Aktywne przypominanie treści, w przeciwieństwie do ich biernego powtarzania czy ponownego czytania, znacząco wzmacniania ścieżki neuronalne i wspiera długoterminowe uczenie się. Dla nauczyciela oznacza to, że skuteczna praktyka powinna obejmować nie tylko ekspozycję uczniów na nowe słownictwo czy struktury, lecz także systematyczne stwarzanie okazji do ich odtwarzania bez bezpośredniego dostępu do materiału źródłowego, na przykład za pomocą testu.

Testy, jaką pełnią funkcję?

Testing is a learning tool, not simply an assessment technique.

[konferencyjny urywek] Carol Lethaby, Evidence-based teaching: combining science and humanism?

Testy to nie tylko narzędzie oceny, ale również stwarzanie okazji do odtwarzania materiału, który chcemy, aby uczniowie zapamiętali- retrieving w akcji ; ). Nie muszą być stresujące ani formalne, warto korzystać z quizów, gier czy testów niskiego ryzyka (low-stakes), które angażują uczniów i pomagają utrwalać wiedzę.

Raz w tygodniu godzina, czy pięć minut dziennie?

Odpowiedź na to pytanie znamy doskonale, również w mediach społeczniościowych wielu nauczycieli zachęca i przekonuje do kilkuminutowej, ale regualrnej nauki. Zazwyczaj spotykałam się z powodami takimi jak: wtedy wyrabiamy nawyk, bo jest to realne i do osiągnięcia. Badania dodatkowo wskazują na jeszcze jedną korzyść:

Studying in one go means you don’t retain that information. Spaced retrieval practice is essential for retention of information, spreading out your practice activities over time.

The closer you are to forgetting it, the more likely you are to benefit from trying to retrieve or practice it again, as it creates a desirable difficulty and increases the storage strength.

[konferencyjny urywek] Carol Lethaby, Evidence-based teaching: combining science and humanism?

Learners need input

Efektywna nauka języka wymaga regularnego i zróżnicowanego kontaktu z materiałem językowym; zajęcia raz w tygodniu nie zapewniają wystarczającej ekspozycji. Dlatego istotne jest, aby zachęcać uczniów do samodzielnego korzystania z języka poza klasą, wykorzystując różnorodne źródła, takie jak literatura, artykuły, nagrania wideo, platformy społecznościowe czy strony internetowe. Ważnym aspektem są również działania, które angażują ucznia w aktywne użycie języka w autentycznych kontekstach (meaningful practice) – to nic innego jak ćwiczenia, które mają dla ucznia sens i cel. Tego rodzaju praktyka sprzyja nie tylko utrwalaniu struktur językowych, lecz także rozwijaniu kompetencji komunikacyjnych: myślenia krytycznego oraz samodzielności w uczeniu się.

Jak AI może mi pomóc w przygotowaniu lekcji?

Powyżej wspomnieliśmy o tym, jak ważne jest tworzenie meaningful resources, poniekąd kontynuując ten wątek chciałabym przyjrzeć się temu, jak AI może wspierać nauczycieli w przygotowywaniu lekcji.

Leonor Corradi w wystąpieniu Backward Design, AI and GSE: a powerful partnership zaproponowała połączenie kilku rzeczy: Backward Design, Global Scale of English (GSE) oraz AI. W podejściu Backward Design zaczynamy od określenia celu lekcji, świetnie nadaje się do tego GSE, która zamiast ogólnych poziomów językowych (B1) oferuje konkretne deskryptory, np.: „Uczeń potrafi mówić o swoich planach na przyszłość, używając going to lub Present Continuous”. Mając jasno określony cel, projektujemy aktywności. AI w tym układzie pełni rolę praktycznego wsparcia: może pomagać w tworzeniu ćwiczeń, dostosowywać treści do potrzeb grupy i inspirować do nowych pomysłów. Jednak to nauczyciel nadaje tym materiałom sens i kształt, dbając o to, aby technologia była wsparciem, ale nie zastępowała procesu myślowego.

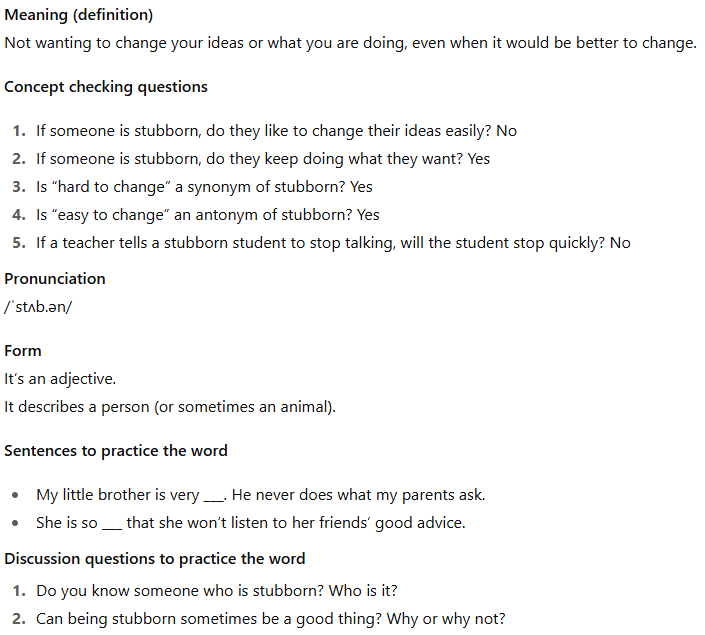

W przypadku poszczególnych zadań, Katerina Protsenko w sesji A framework for creating own AI assistants opowiedziała o funkcji spersonalizowanego czatu. Wystarczy raz określić, co czat ma robić, a czego unikać, aby później korzystać z niego w szybki i uporządkowany sposób.

Przykładem może być czat przygotowany specjalnie do analizy językowej dla nauczycieli angielskiego, z ustawieniem, by korzystał z konkretnego słownika jako źródła informacji. Brzmi mgliście, ale w praktyce, gdy już taki czat stworzę, wystarczy, że wpiszę słowo stubborn oraz przykładowe zdanie, w tym przypadku She is as stubborn as a mule a otrzymam taką odpowiedź:

Dzięki temu rozwiązaniu, nie muszę za każdym razem od nowa i szczegółowo definiować co ChatGPT powinien zrobić.

Kolejne trzy narzędzia zostały zaproponowane przez Russel Stannard (Key AI tools that are impacting teaching and learning).

- gaston.live – pozwala na przekształcenie filmiku z YouTube w tekst, który następnie można wykorzystać w integracji z ChatGPT do tworzenia zadań, np. pytań do filmu. Wersja darmowa ma pewne ograniczenia.

- Natural Readers – narzędzie do zamiany tekstu na plik audio. Niestety nie umożliwia pobrania gotowego pliku. Ogromnym plusem jest akcent i jakość nagrania.

- Luvvoice – działa podobnie, nieco gorsza jakość, ale pozwala na pobranie pliku. (Edit: w ostatnim czasie eksperymentowałam z tym narzędziem, jeśli chcesz zobaczyć jak wykorzystałam je w praktyce, tutaj możesz pobrać darmową kartę pracy).

Coraz częściej mówi się o AI w kontekście środowiska i wykorzystania zasobów. Co z tym aspektem?

AI wiąże się z dużym zużyciem energii i zasobów, zwłaszcza podczas trenowania modeli. Warto o tym pamiętać, wybierając narzędzia i korzystając z nich w sposób świadomy np. ograniczając zbędne przetwarzanie danych. Ciekawostką jest to, że korzystając ze spersonalizowanego AI można ograniczyć zbędne przetwarzanie danych i zużycie zasobów.

Po co w ogóle potrzebny jest nauczyciel, skoro AI może sprawdzić zadanie, przygotować ćwiczenia czy ułożyć plan nauki?

Cytat „AI won’t replace you, but someone using AI will” pojawił się na jednym z wykładów inauguracyjnych. Moja wersja, brzmiałaby mniej więcej tak: AI nie zastąpi nauczycieli, którzy są w stanie umiejętnie analizować odpowiedzi, zauważać błędy, wprowadzać własne poprawki oraz przemycać niuanse. Może jednak zastąpić tych, których AI musi poprawiać.

Oczywiście można ulec pokusie, by wykorzystać sztuczną inteligencję jako substytut kontaktu z nauczycielem. Czas pandemii pokazał nam, jak duża była tęsknota za naturalnością kontaktów. Człowiek jest istotą społeczną i w jego rozwoju ważni są ludzie, z którymi ma kontakt. ChatGPT to przydatne narzędzie do wykorzystania w nauce języka obcego, ale nie zastąpi doświadczenia interakcji z drugą osobą.

Czy za bardzo polegam na AI podczas swoich zajęć?

To pytanie, które warto sobie co jakiś czas stawiać, planując kolejne tygodnie zajęć. Nie istnieje jedna właściwa odpowiedź – tak samo jak w przypadku czasu spędzanego przez dzieci przed ekranami, o czym pisały Joanna Kołak-Rodis i Alicja Kost w W sieci wyzwań i możliwości (kompendium wiedzy o dzieciach w świecie mediów), nie da się tego sprowadzić do prostego zalecenia 1, 1,5 czy 2 godziny dziennie. Wszystko zależy od kontekstu. Inaczej wygląda godzina przed telewizorem w dniu pełnym aktywności, ruchu i kontaktów społecznych, a inaczej w przypadku dziecka, które cały dzień spędziło biernie w domu. Podobnie jest z technologią w edukacji. Sama obecność narzędzi cyfrowych nie przesądza o jakości lekcji. Jeśli są one częścią szerszego planu, w którym jest miejsce na inne formy aktywności, swobodne rozmowy, wykorzystanie realiów, zadania, które pobudzają wyobraźnię i twórcze myślenie wówczas technologia staje się jednym z elementów urozmaicających proces nauczania, a nie celem samym w sobie.

Kluczowe wydaje się nie to, ile korzystamy z nowych rozwiązań, ale w jaki sposób je wplatamy. Warto więc pytać nie czy za dużo, ale czy w równowadze z innymi formami pracy.

W jaki sposób pozostać human w erze AI?

Na tak postawione pytanie, każdy znajdzie swoją odpowiedź. Ja po konferencji dodam tylko: byle świadomie : )